k8凯发一触即发-深扒GPT Image 2:疑似「吞」下了GPT

首页财产ai正文 深扒GPT Image 2:疑似「吞」下了GPT-4o 切磋GPT Image 2强盛缘故原由,认为OpenAI或者不于“纯扩散模子”赛道,可能由GPT-4o主导语义计划,还有从多方面阐发其上风和相干工程解法。 2026-04-28 10:31 ·硅星人樊雅婷 AI投资人解读· GPT Image 2将图象酿成语义密文,由自回归模子定调、扩散模子修饰,年夜幅晋升图象天生效果经由过程数据飞轮自我练习,实现数据的自我提纯推理速率快,还有能与对于话体系整合。 · 行业竞争激烈,其他模子可能会追逐技能依靠在GPT-4o,若其体现欠安,GPT Image 2也会受影响数据飞轮可能呈现模子瓦解问题。 总结:GPT Image 2于图象天生范畴上风较着,具备较年夜投资潜力。但需存眷行业竞争、技能依靠和模子瓦解等危害,建议深切研究其技能细节与市场远景后再做投资决议计划。内容由AI天生,仅供参考

GPT Image 2 凭甚么这么强?

是扩散模子又迭代了一版?是把 DiT 的参数目从 7B 扩到 20B?是训了更多高质量数据?

这些谜底都对于,但都不敷。

如下是咱们与多位从业者交流后,提炼出的几个值患上存眷的技能标的目的,并测验考试做出更清楚的注释。

先给结论:OpenAI 极可能已经经不于“纯扩散模子”这条主赛道上了。他们已经经把图象天生从“美术课”调到了“语文课”——用一个能读懂指令、能记住上下文、能理解物体瓜葛的 LLM 主导语义计划,至在末了一步的像素天生,可能由扩散组件或者其他解码器完成。

而这个LLM,极年夜多是GPT-4o。

支撑这个推论的,起首是两条直接线索。

模子自述

C2PA溯源验证

C2PA 是一种内容溯源尺度,相称在给每一张 AI 天生的图打上一个数字身份证。任何人拿到这张图,都能查到它是由 GPT Image 2 天生的、天生时间是甚么、颠末了哪些修改。

有专业人士于metadata2go.com上对于image 2天生的图片举行元数据提取。发明于actions_software_agent_name一栏上记载着GPT-4o。

这也能理解为何此次image 2的体现惊人了。

图片源在: 【深切查询拜访:OAI最新图象模子底层是GPT-4o - 祈星函 | 小红书 - 你的糊口兴致社区】 https://www.xiaohongshu.com/discovery/item/69ea80200000000020003800?source=webshare xhsshare=pc_web xsec_token=CB9e0Yo8HLTCLA1XJWh0wUnT3SogJv370RfNnvUD6YFVY= xsec_source=pc_share

单凭这两条固然不足以拆解全数奥秘。但当咱们带着“LLM 主导”的假设转头审阅它的每一一项能力跃迁时,这些变化,突然有了同一的注释。

1、图象语义,从像素到token

1.1

已往两年,AI 生图范畴有一条不可文的藐视链:Midjourney 卖力美学,Stable Diffusion 卖力可控性,DALL·E 卖力……嗯,卖力被 OpenAI 发布。但无论你站哪一队,有一件事是所有人的共鸣——文字是 AI 的地府。

你能让 AI 画出逆光下缅因猫毛发的半透明质感,却没法让它写对于招牌上的“Coffee”六个字母。一个能理解*光影描写的模子,于文字上给出的成果恍如楔形文字。这件事的怪诞与泉源,就藏于扩散模子的事情道理里。

先说扩散模子为何写欠好字?

由于它的焦点是一个从噪声中还有原图象的“雕塑家”:

练习时,向清楚照片慢慢撒噪声,直到酿成纯电视雪花,模子进修逆向去噪。

天生时,从一片随机噪声最先,每一步都靠 U-Net 猜测并擦除了噪声,几十步迭代后“雕”出毛发、虹膜及光影。

这个历程素质上于还有原持续的、可以用几率无穷迫近的纹理。毛发可以轻微硬一点或者软一点,颜色可以偏暖 5%,无伤风雅。

但文字是离散符号,不存于“像不像”,只有“是否是”。字母 A 就是 A,你不克不及给它加 15% 的 B 及 8% 的 C 还有期望它依然是 A。扩散模子的每一一步去噪都是一个微小“预计”,用于纹理上是气势派头,用于文字上就是 O 变 0,或者是拼出 WElcOm e。

终极就成为了生手眼中的“楔形文字”。

不仅云云,扩散模子自然缺少跨轮编纂的不变一致性。你让它改一个局部,它素质上是整张图从头画一遍,没改动之处也会暗暗漂移。

但GPT Image 2此刻不仅能“写对于字”,还有能连结“有影象”的一致性例如:你修改一个字以后,周围的文字会主动调解间距;当你把“咖啡”改为“红茶”,它不只是替代阿谁词,而是连带把杯子的颜色从深棕调成为了虎魄色。

这申明文字于它的体系里不是图层标注,而是画面语义的一部门。文字内容的改动会像语言中的主语替代同样,连锁驱动画面其他元素的合理变化。

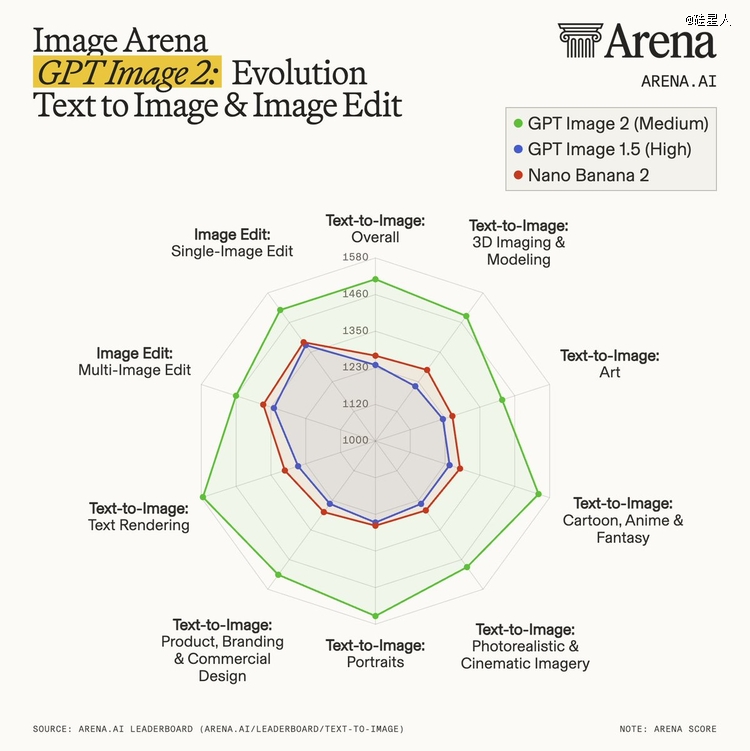

GPT Image 2 与其他模子对于比图

1.2

它再也不把图象当图象看,而是把图象当语言看。

这听起来像形而上学,但实在是个很详细的工程选择。要理解这件事,患上先弄大白一个观点:Tokenizer。

Tokenizer 的作用是把一种工具“翻译”成另外一种工具。GPT 处置惩罚文字前,会先把“你好”这个词切碎编号,酿成一个数字 ID,好比 [11892]。这是文本 token 化。

图象能不克不及也这么干?固然能。你把一张图切成 16×16 的网格,每一个格子编个号,也是一种 token 化。但这类做法太粗笨——一张 1024×1024 的图会酿成几千个 token,LLM 还有没最先画就先被淹死了。

以是已往两年,各家年夜模子公司于拼一件事:怎么把一张图压成只管即便少的 token,同时还有不丢要害信息。

这事有多灾呢?想象你是一个谍报员,要把《蒙娜丽莎》用一封电报发出去。电报局划定你至多只能发 256 个字。你怎么办?你不克不及说“一个女人于笑”,由于对于方画不出来;你也不克不及逐个像素描写,由于字数不敷。你必需发现一套只有你及对于方懂的私语——“52号微笑、3号配景、17号手势”——对于方收到后能八九不离十地还有原出来。

这就是 OpenAI 于 tokenizer 上干的 事。从 CLIP 到 DALL·E 再到 GPT-4o,他们逐渐构建了一种可以或许于视觉与语言之间举行映照的语义暗示系统。

这象征着:图象及文本被投影到了统一个对于齐后的语义 embedding 空间。

此刻于 LLM 眼里,“一只逆光的缅因猫”这行字,及一张逆光缅因猫的照片,是统一个语义空间里的两套坐标。它能像理解文字同样理解图象,也能像天生文字同样天生图象。

以是当你说“把第三行公司名改为团伙名”,它不是于修图软件里找阿谁图层,而是于改写一段描写这个画面的密文。改完后,解码器再把密文翻译回像素。

这就是为何文字忽然能写对于了。由于对于 LLM 来讲,写一个W及写一个我,没有任何素质区分——都是它于私语体系里调解几个 token 的事。

1.3

既然 GPT Image 2 极可能把图象酿成了语义密文,那这串密文怎么变回一张能看的图?

假如直接把 token 映照成像素,画质一定乌烟瘴气,这是自回归模子的通病:它极端擅长决议画甚么,却不太擅长画患上都雅——就像修建系传授徒手画效果图,空间瓜葛全对于,笔触就是不和美院学生。

而扩散模子正好相反,纹理光影以假乱真,却常常不知道本身于画啥。是以,一个高度自洽的推测浮现:让两款模子打共同。

自回归卖力定调:按照你的 prompt 天生那几百个语义 token,敲定画面里有甚么、它们的位置瓜葛、总体构图逻辑。这一步决议了“听患上懂”,也包管了多轮编纂时对于修改对于象的影象与一致性。

扩散卖力修饰:拿到这串语义 token 后,再也不卖力理解内容,只卖力填充高保真像素,把既定框架酿成光影天然的成图。这一步决议了“画患上好”。

这不是理论幻想。Google 发过一篇叫 Transfusion 的论文,Meta 弄过 Chameleon,走的都是近似线路。

固然,这一切都是基在公然信息及模子体现的揣度。

OpenAI 有无于用?2026 年 4 月的媒领会上,OpenAI 拒绝回覆任何干在模子架构的问题。拒绝自己就是一个旌旗灯号。

假如这个假定建立,那就注释了一切——文字写对于是由于自回去世然懂离散符号;多轮编纂一致是由于自回归记住了那一串 token;画质没崩是由于扩散于末了一关做了邃密衬着。

2、数据飞轮,GPT-4o 本身教本身生图

2.1

但上文阿谁能把图象压成几百个 token 的“私语体系”,究竟是怎么训出来的?为何不是另外模子,恰恰是GPT-4o?

谜底藏于一件看起来最没有技能含量的事里:数据标注。

于 AI 圈,数据标注持久处在藐视链底端。研究员聊架构可以聊一夜,聊数据标注三句话就冷场。但 GPT Image 2 此次的体现,甚至注解OpenAI 可能已经经不需要人工标注了。

而GPT-4o 自己就是全球最强的图象理解模子之一。你给它一张图,它能写出一段比真人标注师还有细腻的描写。以是OpenAI 可以把已往几年堆集的几十亿张图片,从头“过一遍水”——用 GPT-4o 天生新的、高维度的标注。

但到这里,只解决了“描写”的问题,没解决“筛选”的问题。一个模子天生一百张图,其实不是每一一张都值患上拿来当下一轮练习的教材。这里需要一套严酷的“质检”机制——于呆板进修里,这叫拒绝采样。

详细来讲就是,GPT-4o 先按照一段 prompt 天生一批图象,然后按照美学偏好、指令匹配度、物理合理性等多条尺度,逐张打分。批到切合前提的才“收下”,连同它为本身撰写的具体解析,一路塞进下一轮练习集。批到不和格的就直接扔失。这包管飞轮里的数据不是于低程度轮回,而是于有选择地自我提纯。

上一代模子给下一代模子当教员,下一代模子再给下下代当教员。每一转一圈,对于世界的理解就深一层。

各人的差距也于这个历程中愈来愈年夜。这也注释了为何Midjourney于画质上能及OpenAI掰手段,但于指令遵照及文字衬着上被拉开代差。

固然,听上去像个永念头圈套——本身教本身,那不患上越教越傻?学术界确凿有这个担心,管它叫模子瓦解:模子重复吃本身吐出来的工具,会逐渐丢掉漫衍的尾部信息,天生成果愈来愈单1、愈来愈平淡。

但OpenAI于文本侧已经经证实:只要教员模子充足强,而且共同拒绝采样如许的严酷筛选机制,这事不单不会崩,还有能加快,形成数据飞轮。

2.2

这个飞轮里还有有一个主要且难弄的脚色——RLHF 于图象侧的质检员。

咱们于文本侧已经经习气了 RLHF(Reinforcement Learning from Human Feedback,基在人类反馈的强化进修):给一段文字打分,判定它有效、有趣、切合人类偏好,这件事 GPT-4o 做患上很好。

但于图象侧,难度骤升。由于质检员需要同时盯住三条线:美学偏好;指令遵照;安全过滤。

三条线的尺度各不不异,甚至互相冲突。一道强光影可能很“都雅”,但压暗了 prompt 里要求的某个细节,就会被“指令遵照”扣分。一层安全滤镜可能误伤正常的医学剖解图,又患上转头调阈值。这类多维度衡量,于文本侧已经经跑通,但于图象侧变患上史无前例的繁杂。

而 OpenAI 之以是能做成,极可能是由于他们把图象侧的问题全数拉回了本身最擅长的疆场:语言理解。

美学偏好被转译成一段构图考语,指令遵照被转译成一组约束前提的查对清单,安全过滤被转译成一套法则判例。所有判定终极都落到了 LLM 的语义空间里。

可能这才是数据飞轮真实的底牌。不是数据多,而是从标注、筛选到打分,全链路都被同一到了一个理解框架里。拒绝采样卖力海选裁减,RLHF 卖力精修调优,二者同享一套语义尺度,飞轮才转患上起来。

3、工程解法,统筹推理速率及对于话整合

3.1

到这里,咱们聊的都是效果。接下来聊一个常常被决心绕开的话题:推理速率。

先不说审美及一致性上的奔腾,且说一个看似抵牾的征象:生图质量跃升了一个代际,但速率并无较着变慢。这自己就是一种工程古迹——OpenAI 是怎么做到的?

自回归模子的运作方式是逐 token 天生——每一个 token 都依靠上一个 token 的完成。扩散模子则差别,它可以于整张画布上并行去噪,一次处置惩罚所有像素。按理论推算,假如 GPT Image 2 确凿用了自回归架构,它的推理延迟应该比纯扩散模子超出跨越一个数目级。

但现实体验是:没有。

*条线索:Token 压缩率可能远超预期。假如一张 1024×1024 的图只需要 256 个 token 就能完备描写,对于 Transformer 来讲就是一次呼吸的事。这象征着OpenAI 不仅做到了语义对于齐,更于压缩率上做到了*,把高信息密度浓缩到几行字的水平。

第二条线索:推理架构的深度优化。混淆架构中,自回归天生的是粗粒度的语义 token,决议“画甚么”,不卖力“画成甚么样”。天生步调年夜幅缩短,扩散模子只用于末了一小段“按图施工”,而不是重新噪到尾。

第三条线索:谋利解码(Speculative Decoding)可能被用到了图象侧。用一个更小的“底稿模子”快速天生候选 token,再由年夜模子一次性验证,这套 LLM 推理加快经典技巧假如用于图象 token 上,速率可以成倍晋升。OpenAI 于 GPT-4 时代已经把这套玩熟,移植到图象侧没有道理障碍。

以是结论是:GPT Image 2 的快,不是由于扩散模子变快了,而是由于可能它把最慢的语义计划,从扩散模子手里抢了过来,交给了擅长快速推理的 LLM。

3.2

比速率更影响体验的,是与对于话体系的整合。

于传统图象天生东西中,例如 Midjourney 或者基在 Stable Diffusion 的事情流,用户凡是经由过程编写 prompt 来节制输出成果。虽然这些东西已经经撑持诸如variations、inpainting及汗青记载等功效,但总体流程仍旧以“单次输入 → 单次输出”为主,用户需要经由过程屡次测验考试慢慢迫近方针效果。

这类历程于实践中往往体现为重复试错:

用户按照成果调解 prompt,但模子对于指令的理解水平其实不彻底透明,是以需要多轮迭代来校订误差。

比拟之下,集成于对于话体系中的图象天生引入了持续上下文机制,转变了交互方式。

用户可以于多轮对于话中慢慢细化需求

模子可以或许使用对于话汗青理解“当前修改”对于应的对于象或者属性

修改哀求可以以更天然语言的情势表达,而不需要一次性写出完备 prompt

例如,于多轮交互中,用户可以师长教师成一个基础场景,再慢慢提出局部修改(如颜色、位置、气势派头)。末了,模子基在上下文天生新的成果。

对于话式交互还有带来另外一个上风:需求澄清能力clarification。将恍惚的天然语言用意,慢慢转化为更详细的天生前提,从而提高天生成果与用户预期之间的一致性。

结语

于 GPT Image 2 呈现以前,AI 生图范畴的会商框架是如许的:

“扩散模子的缩放定律还有能走多远?”

“DiT 架谈判 UNet 架构谁更优?”

“Flow Matching 会不会代替 DDPM?”

“多模态对于齐的丧失函数怎么设计?”

这些问题都有价值,但它们同享一个隐含条件:图象天生是一个自力的、需要专门架构来解决的问题。

而GPT Image 2 给出的的回覆是:纷歧定。

假如咱们把镜头再拉远一点,GPT Image 2 的呈现实在指向了一个更年夜的命题:世界模子。

让咱们从头思索甚么是天生,以和世界。

【本文由投资界互助伙伴硅星人授权发布,本平台仅提供信息存储办事。】若有任何疑难,请接洽(editor@zero2ipo.com.cn)投资界处置惩罚。

-k8凯发一触即发